дипфейк что это значит

Вооруженный глаз: как распознать дипфейк

Дипфейки — это видеоролики, в которых одно лицо подменяется другим с помощью алгоритмов машинного обучения. Если несколько лет назад подобные имитации были довольно топорными и вызывали большей частью смех, то сегодня технология качественно эволюционировала. И, как это часто бывает с новинками, немедленно была взята на вооружение криминалом. Сгенерированный компьютером голос начальника просит сотрудника перевести крупную сумму, а звезд шоу-бизнеса и политиков терроризируют фальшивыми порнороликами с их участием. Эксперты прогнозируют, что по мере сбора биометрических данных риск мошенничества возрастает. Как распознать дипфейк и какие меры вводятся для борьбы с подобного рода манипуляциями — в материале «Известий».

Кейдж и обнаженка

Считается, что первые дипфейки появились в конце 2017 года, когда пользователь Deepfakes выложил на Reddit порнографические ролики, в которых лица актеров были заменены на лица голливудских звезд. Технология разошлась по Сети и породила массу подобного контента. Чуть позже, наигравшись с роликами для взрослых, пользователи взялись за Николаса Кейджа. С помощью приложения FakeApp, запущенного в январе 2018-го, американский актер был помещен в фильмы, в которых никогда не принимал участия. А несовершенность технологии только прибавила видео веселости.

В дальнейшем опыты стали более разнообразными: Сильвестр Сталлоне «превратился» в мальчика Кевина из фильма «Один дома», Арнольд Шварценеггер «сыграл» всех персонажей во «Властелине колец», а Илон Маск «исполнил» песню «Трава у дома».

Между дипфейками есть свои различия. Наверняка многие встречали видео, на которых пользователи «примеряют маску» знаменитых политиков, дарят им свою артикуляцию и заставляют говорить странные вещи. Данный метод называется Face2Face. Подделка создается в режиме реального времени и в отличие от собственно DeepFake не подменяет одно лицо другим, а искажает мимику исходного объекта.

Однако в последние годы термин deepfake используется в широком смысле — им обозначают все типы имитирующих видео, созданных искусственным интеллектом.

Механизм работы

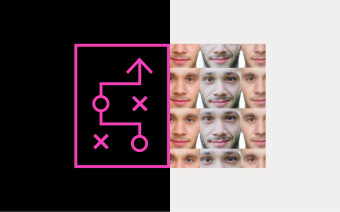

Дипфейки создаются при помощи метода глубокого обучения, известного как генеративно-состязательная сеть (GAN). Его суть заключается в соревновании двух нейросетей: генератора и дискриминатора. Генератор создает подделку, а дискриминатор пытается понять, настоящее перед ним изображение или нет. Чем лучше обманывает генератор, тем выше конечный результат.

Прежде созданные GAN изображения отличались довольно низким разрешением. По размытости картинки можно было легко идентифицировать запись как сгенерированную. Это ограничение было преодолено в версии ProGAN, благодаря которой разрешение подскочило до 1024×1024 пикселей.

Другая модель — StyleGAN — научилась мастерски создавать лица несуществующих людей. Нейросеть обучилась на библиотеке реальных фотопортретов и стала сама генерировать человеческие образы.

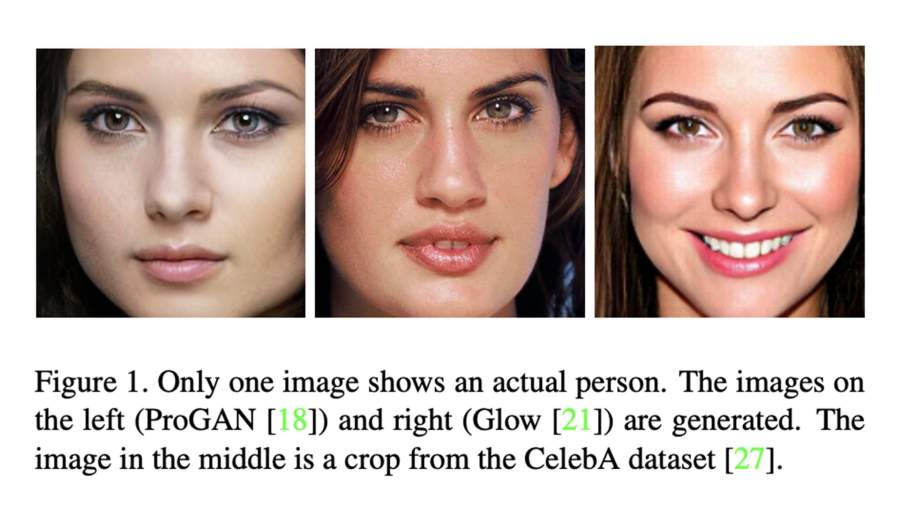

Насколько высоки результаты в генерации новых лиц, можно убедиться на примере картинки ниже. Только на одной из трех фотографий изображена реальная девушка. Она посередине.

Как распознать подделку?

Точность и высокое качество дипфейков вызвали рост недоверия пользователей Сети к видеоконтенту. Однако при более внимательном рассмотрении в некоторых роликах заметны цифровые артефакты — недостатки, которые выдают имитацию. Для обоих поколений дипфейков (ранних недостаточно реалистичных и поздних гиперреалистичных) выявление артефактов происходит по одним и тем же участкам лица. Ученые из Университета Эрлангена–Нюрнберга описали возможные ограничения в своей статье.

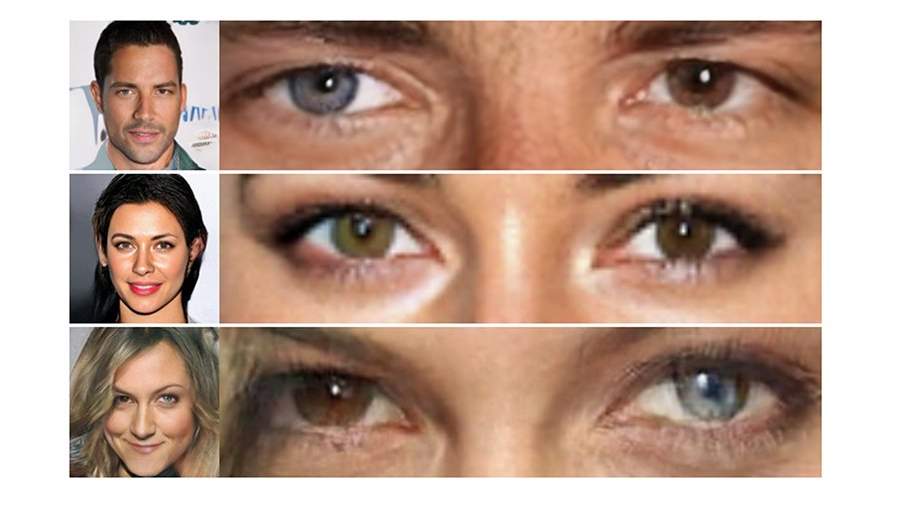

Несуществующие лица. Часто у сгенерированных моделей не совпадает цвет левого и правого глаза. В природе явление гетерохромии встречается весьма редко, поэтому смешанные или отличающиеся цвета могут стать сигналом для опознания дипфейка. Также стоит иметь в виду, что расстояние от центра глаза до края радужной оболочки должно быть одинаковым для обоих глаз. Кроме того, ожидается, что оба лимба будут иметь правильный округлый контур. Обнаруженные артефакты проиллюстрированы на картинках ниже.

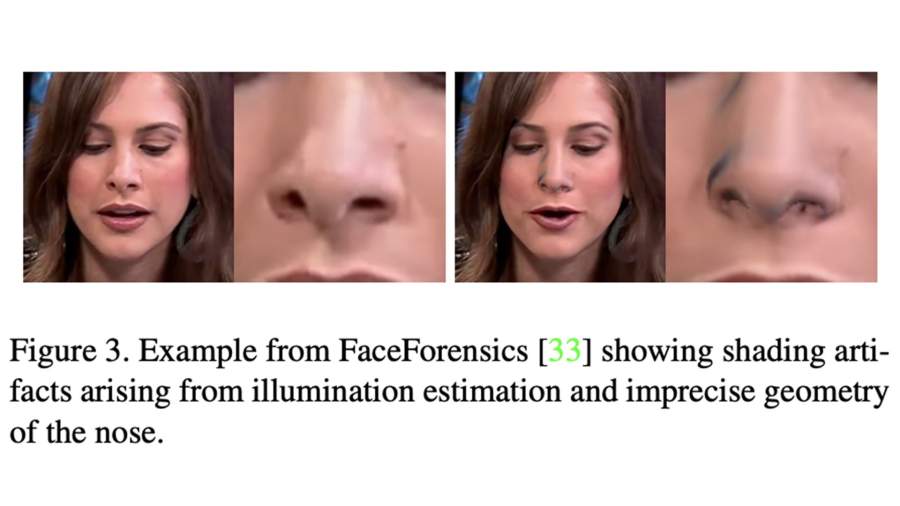

Face2Face. Для данного метода будут показательны границы лица и кончик носа. Неточное наложение маски приводит к артефактам затемнения, когда, например, одна сторона носа может казаться темнее другой. При этом контуры маски резко отделяются: это хорошо видно внизу лица и над бровями. Элементы, которые частично закрывают части лица (например, пряди волос), моделируются неправильно и могут привести к образованию «дыр».

DeepFake. Для дипфейков наиболее уязвимыми считаются глаза и зубы. Многие образцы имеют неубедительные зеркальные отражения — блики в глазах либо отсутствуют, либо кажутся упрощенными. Этот артефакт делает глаза тусклыми. Другой минус — непрорисованные зубы. Бывает, они вообще не моделируются, а выглядят как отдельное белое пятно.

Deepfake: краткая история появления и нюансы работы технологии

Немного истории

Технологии синтезирования видео и аудио нельзя назвать новыми. Они разрабатываются с конца 90-х годов XX века. Конечно, разные попытки делались и до этого, но мы говорим о тех технологиях, которые получили продолжение. Так, в 1997 году компания Video Rewrite представила технологию, которая позволяла сформировать видео, где артикуляция лица совпадала с синтезированной аудиодорожкой. Т.е. моделировалась артикуляционная мимика лица, которая полностью соответствовала синтезированной компьютером аудиодорожкой.

Но это были лишь первые попытки, которые активно развивались в течение двух десятков лет. Сейчас нам доступны технологии обработки голоса, объединения компьютерной графики с реальными видео и многое другое. Не везде применяется ИИ, но все же самые реалистичные системы сформированы на базе машинного обучения.

Появление «настоящих» дипфейков

Технология Deepfake упрощает процесс синтезирования изображения и создания звуковых дорожек с заданными параметрами за счет использования нейронных сетей. Они обучаются на сотнях или даже тысячах примеров лиц и голосов, с ними связанными. После этого ИИ показывает весьма впечатляющие результаты.

Нет сомнения, что с течением времени будут появляться все более реалистичные дипфейки. Уже сейчас они никого не удивляют, а в ближайшем будущем и вовсе станут привычным делом. Но кто отвечает за развитие технологий, где они используются, как работают и чего нам ожидать в будущем?

Современные игроки

Большинство крупнейших технологических игроков и развлекательных компаний активно исследуют отрасль «синтетических медиа». Amazon стремится сделать голос Алексы более реалистичным, Disney изучает, как использовать технологию смены лица в фильмах, а производители оборудования, такие как Nvidia, расширяют границы синтетических аватаров, а также услуг для кинопроизводства и телевидения.

Но есть и организации, которые создают технологии, позволяющие отличить подделку от реальности. В их число входят, например, Microsoft и DARPA.

К слову, у большинства ПО по созданию дипфейков открытый исходный код, что дает возможность работать с дипфейками даже небольшим компаниям. Проектов достаточно много. Это, например, Wombo, Аvatarify, FaceApp, Reface, MyHeritage и многие другие.

Как создаются дипфейки

Классическая компьютерная обработка изображений использует сложные алгоритмы, созданные при помощи традиционного программного обеспечения. Эти алгоритмы чрезвычайно сложны. Как говорилось выше, совсем недавно дипфейки представляли собой контролируемую модель, которой управляют разработчики. Подавляющее большинство элементом артикуляционной мимики жестко прописывалось в алгоритмах.

Правда, для того, чтобы создать убедительный дипфейк, требуются большие объемы видео, статические изображения, голосовые записи, а иногда даже сканирование головы реального актера с последующим анализом в качестве обучающих вводных данных. Например, клиенты Synthesia в течение примерно 40 минут снимают на видео, как они зачитывают заранее подготовленную речь, чтобы потом этот контент использовался для обучения нейронными сетями.

Несмотря на весьма впечатляющие результаты, дипфейки, создаваемые ИИ, не являются идеальными. У дипфейков есть ряд хорошо заметных (не для человека, для специализированного ПО) признаков, которые пока еще позволяют отличить реальность от вымысла. Это, например, нюансы освещения и теней, мигание, артикуляция, выражение и тон голоса. Для создания убедительного дипфейка все это нужно правильно комбинировать.

Изображения и видео

Достаточно часть в этом направлении используется Variational Autoencoder – VAE. Это генеративная модель, которая находит применение во многих областях исследований: от генерации новых человеческих лиц до создания полностью искусственной музыки. Что касается видео, то VAE позволяет достаточно быстро перенести особенности мимики и артикуляции определенного человека на сформированную объемную модель. VAE используется достаточно давно, но дипфейк, созданный при помощи этой технологии, несложно выявить.

А вот с 2017 года развиваются генеративные состязательные сети (GAN). Здесь в единое целое объединены, по сути, две нейронные сети. Одна, «дискриминатор», определяет реалистичность модели, созданной другой нейросетью. На выходе получается модель, которая была «одобрена» и является наиболее реалистичной.

Что дальше?

Дипфейки также поднимают множество вопросов о том, кому какой контент принадлежит, что делать с лицензиями и как наказывать нарушителей. Так, уже сейчас актеры заключают контракты с компаниями, разрешая использовать их образ и голос в рекламе или фильмах. Но, вероятно, некоторые компании будут использовать дипфейки знаменитостей в своих целях без всяких разрешений.

Что такое дипфейк, почему он опасен и как его распознать?

Вы видели, как королева Елизавета танцевала на столе, произнося новогоднее послание? Или вы слушали речь Ким Чен Ына о демократии или восхищались Сальвадором Дали, рассказывающим о своей смерти (в которую он не верит)?

Все эти удивительные фильмы объединяет одно — они фальшивые. Deepfake — это создание и публикация ложной информации в виде видео, аудио и фотографий. Создавать Deepfake становится все проще, поэтому мы подготовили руководство по созданию, распознаванию и поиску дипфейков в Интернете.

Что такое дипфейк?

Deepfake — это, по сути, фото, видео или аудио материал, который не является реальным. Он создается с помощью алгоритмов, основанных на реальных образцах голоса, звука, видео или фотографий, которые объединены вместе. Алгоритм берет информацию из множества разных мест и затем объединяет их в один материал. В результате создается нечто новое (не настоящие), основанное на сопоставлении различных реальных данных.

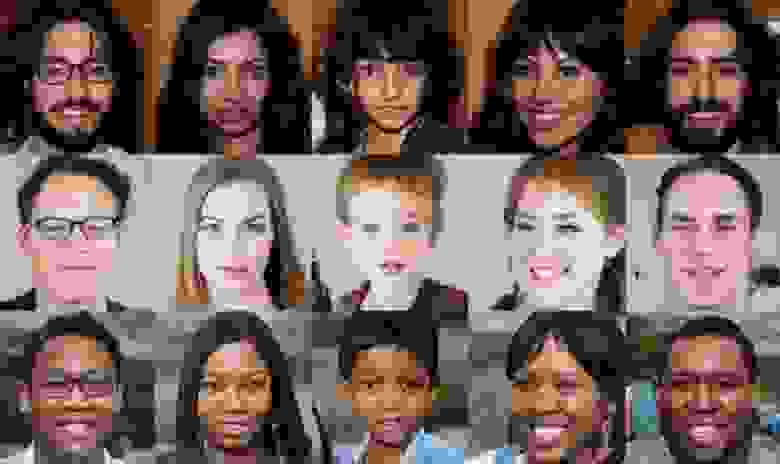

Но не только это. Deepfake также может «рисовать» фотографии с нуля, например, создавая персонажей и лица людей, которых никогда не существовало.

Какова цель такой инновации? Deepfake используется для размещения ложной информации в Интернете (например, о политических событиях), взломе, краже (в том числе подделку голосовых команд). Его также можно использовать в образовательных и развлекательных целях.

Deepfake — как это работает?

Есть два метода создания дипфейк-материала.

Первый использует два алгоритма. Кодировщик ищет общие черты двух изображений (которые нужно объединить в одно), второй (декодер) может передать их в новое ложное изображение. Например, если мы хотим, чтобы актер двигался так же, как мы, кодировщик будет изучать движение из видео с танцами. Декодер превратит наше лицо в лицо актера и заставит его реагировать таким же образом. Ключевыми здесь являются выбранные функции, которые копируются в новое изображение (например, движение рта, жесты, мимика).

Второй способ — через генерирующие состязательные сети (GAN), где два алгоритма работают вместе. Первый называется генератором, потому что, используя общую информацию, он создает изображения (например, изображение человека), определяя другие его отличительные черты (у человека есть тело. У человека есть лицо. У человека есть глаза). Второй алгоритм — это дискриминатор, который оценивает, верны ли изображения, предоставленные ему генератором.

Со временем оба алгоритма становятся все более и более совершенными за счет обучения. Если генератор настроен так, что дискриминатор не распознает фальшивую фотографию (считает ее настоящей), процесс можно считать завершенным.

Поддельные записи остались в прошлом. Теперь нам нужно остерегаться фейковых видео.

Угроза Deepfake — с каких пор она существует?

Впервые подобная ложная информация появилась в 2017 году. На тот момент пользователь под псевдонимом deepfake опубликовал на Reddit несколько порнографических фильмов, в которых принимали участие знаменитости, в т.ч. Скарлетт Йоханссон, Галь Гадот и Тейлор Свифт. С тех пор эта область сильно развивается, потому что дипфейк-фильмы может делать практически любой.

Как сделать дипфейк?

Если дипфейк-видео может делать кто угодно, можно ли его снимать дома? Однозначно да, но их качество не будет идеальным. Для их создания вам потребуются большие вычислительные ресурсы и мощные видеокарты.

То, что у нас обычно есть в домашних компьютерах, недостаточно, а сам процесс разработки может занять несколько недель. Качество фильмов тоже оставляет желать лучшего — будут видны ошибки, движение рта может не совпадать со звуком, и будут видны места, где «старый» контент перекрывается с «новым».

Однако, если мы хотим немного «подправить» фотографию или сделать короткий дипфейк-фильм, программу можно загрузить прямо на смартфон. Очень простое в использовании приложение исправит недостатки красоты за несколько мгновений, превратит нас в избранных знаменитостей или позволит нашей собаке говорить человеческим голосом.

Как распознать дипфейк?

Профессиональные дипфейк-видео становится все труднее и труднее распознать. Первоначально у алгоритмов были проблемы с базовым поведением (например, с морганием глаз), и это сразу выдавало поддельное видео. Эта ошибка исправлена. Поддельные персонажи моргают, двигаются естественно, а также бегло говорят. Однако иногда у них возникают проблемы с естественным движением глаз.

Так как же обнаружить дипфейк? Вот на что следует обратить внимание при просмотре видео:

При анализе материалов на дипфейк также стоит полагаться на собственные ощущения. Иногда создается впечатление, что что-то «не так».

Прежде чем поверить найденной информации, обязательно ее проверьте.

Deepfake на русском языке — где можно встретить?

Ложный материал можно найти везде, где он может охватить большую аудиторию, то есть потенциальную аудиторию дипфейков. Вк, Одноклассники, Instagram, TikTok и другие социальные сети полны такого рода материалов. Это не только видео, но и «доработанные» фото и аудиозаписи. Некоторые из аутентично выглядящих профилей были полностью заполнены дипфейком!

Это не единственные места, где можно найти дипфейк. Приложение для смартфона, которое позволяет добавить на фото усы и бороду или другие спецэффекты (например, старение на несколько десятилетий), также основано на этом механизме.

Deepfake — фильмы

Deepfake можно использовать по-разному, как положительно, так и отрицательно.

Материалы Deepfake также могут иметь образовательные функции, «воскрешая» умерших артистов, певцов и музыкантов. Некоторые музеи (в том числе Музей Сальвадора Дали во Флориде) используют эту технологию. Благодаря этому сам художник показывает туристам свои коллекции, с которыми можно поговорить и даже сфотографироваться.

Записи Deepfake можно использовать в генераторах голоса — устройствах, предназначенных для людей, потерявших способность говорить. Благодаря им они все еще могут говорить с нами своим голосом.

К сожалению, мы также имеем дело с негативным использованием дипфейка. Политика — это пример того, как ложная информация такого рода может иметь далеко идущие глобальные последствия, в том числе: дискредитировать общественных деятелей, влиять на фондовый рынок, экономику или результаты выборов. Хорошо подготовленный фильм также упрощает манипулирование общественным мнением. Прогрессивное развитие технологий затруднит различение настоящих и поддельных материалов. Следовательно, это шаг к снижению общественного доверия и информационному хаосу.

Обязательно посмотрите примеры дипфейков

Угроза Deepfake — реальна для всех нас

Deepfake — это проблема не только американских актеров и политиков. Подделка может повлиять на любого. Созданное видео, в котором мы совершаем преступление или попадаем в не однозначную ситуацию, может стать элементом шантажа и вымогательства. Если вы ведете активный бизнес, дипфейк можно использовать для дискредитации компании среди ее подрядчиков.

Растущее количество подтасованных материалов также повлияет на социальное доверие и веру в предоставленную информацию. Как верить чему-либо, когда фильм, являющийся доказательством в суде, может быть неправдой, а в новостях описываются несуществующие события?

Чем больше записей с данным человеком, тем проще создать дипфейк.

Борьба с дипфейком

Поток ложной информации настолько велик, что многие социальные сети решили бороться с дипфейком. Facebook и Twitter пытаются обнаружить поддельные видео и автоматически удалить их. Крупные корпорации (в том числе Microsoft или Amazon) вкладывают средства в создание программного обеспечения, которое легко обнаруживает подделанные материалы. Ученые также работают над решениями.

Однако в ситуации, когда приложения для смартфона достаточно для создания фейкового фильма, борьба с дипфейком — это борьба с ветряными мельницами. Также отсутствуют правовые нормы, которые определяли бы последствия манипулирования информацией или использования чьего-либо изображения таким образом.

Резюме

Deepfake становится все более популярным, и его все труднее отличить от правды. Это связано с совершенствованием технологий, лучше имитирующих движения и жесты человека. Программное обеспечение Deepfake можно использовать с хорошими целями, создавая учебные материалы, но они также являются инструментом для хакеров, шантажистов и интернет-троллей.

Поэтому, если вы снова наткнетесь на удивительное видео в сети, сначала проверьте, не было ли оно создано искусственно. Возможно, то, что вы смотрите, никогда не происходило!

Если вы нашли ошибку, пожалуйста, выделите фрагмент текста и нажмите Ctrl+Enter.

Дипфейки: кому и зачем они нужны

Дипфейк (deepfake) – производная от «глубокого обучения» и «подделки»; штука, про которую сегодня большинство говорит с опаской. Само название как бы кричит: «Я зло!». А наша гипотеза в том, что это технология с огромнейшим позитивным потенциалом, которая пока используется в основном как игрушка в руках неразумного человека. Что это и как на самом деле? Давайте разбираться.

Дипфейки используют технологии искусственного интеллекта для синтеза изображений, в результате чего один персонаж как бы накладывается на другого и получается «комбо»: оживает Мона Лиза или Терминатором становится Бред Питт.

Эта технология позволяет легко манипулировать аудио- и видеоконтентом, а по мере того, как она развивается, разобраться, где правда, а где фейк – становится всё сложнее. Так в прогремевшем на весь интернет видео Барак Обама критикует Дональда Трампа, называя его «полным провалом». В США считается, что дипфейки представляют угрозу национальной безопасности. В Калифорнии некоторые виды дипфейков даже запретили законодательно.

Чаще всего дипфейки создаются с помощью генеративно-состязательной сети (GAN), в ней 2 системы: генератор и дискриминатор. Они работают как пара студентов в университетской микрогруппе: один предлагает идеи, другой их критикует. Генератор создаёт изображения, а обученный на реальных фотографиях дискриминатор подсказывает, что нужно исправить.

Заметим, что технология постоянно развивается. Так, например, алгоритм BigGAN от Google и NVIDIA позволяет не просто воссоздавать, а создавать лица несуществующих людей, которые невозможно отличить от настоящих.

Недавно разработчики из Samsung и Сколково представили алгоритм на основе BigGAN, который позволил «оживить» Мону Лизу, то есть для (относительно) хорошего результата нейросети достаточно одного кадра. Нейросеть работает лучше всего, если дать ей несколько изображений человека, снятых под разными углами.

Сейчас на рынке десятки приложений, с помощью которых любой может сделать дипфейк, самые известные – Zao, DeepFaceLab, Deepfakes web β.

Конкурентные преимущества приложений похожи на классический треугольник «цена-качество-скорость»:

– Скорость. Одни выполняют конверсию за секунды, другим нужны часы.

– Необходимое количество исходного материала. Некоторым достаточно одной фотографии.

– Точность итогового результата. Обычно чем больше исходного материала и дольше идёт процесс анализа, тем точнее получается результат.

Год назад NVIDIA представила нейросеть, которая может превращать скетчи в реальные изображения. Технологию назвали GauGAN в честь Поля Гогена. Такую штуку можно использовать в архитектуре, дизайне, создании игр, да где угодно.

Технологию, которая лежит в основе дипфейков, можно использовать и в киноиндустрии, рекламе или при реконструкции исторических событий. Например, с её помощью была сделана социальная реклама, в которой Дэвит Бэкхем рассказывает об опасности малярии на 9и языках.

Музей Сальвадора Дали во Флориде «оживил» художника с помощью всё той же технологии. В результате зрители могли пообщаться с Дали, послушать его истории и даже получить совместное селфи. Для этого потребовалось 6000 фотографий Дали, 1000 часов машинного обучения и 145 видео с актером похожих пропорций, а ещё горы интервью и писем художника, чтобы воспроизвести голос, акцент и манеру речи.

Кстати, алгоритм GAN предлагается использовать и в астрофизике для того, чтобы избавляться от помех и шумов при съёмке космических объектов и получать качественные изображения.

Если вы тоже считаете, что человеческий интеллект создан для творчества, а машинный – для работы, присоединяйтесь к нам на YouTube или в Facebook!

Дипфейки: дезинформация или шаг в будущее?

Фейки на выборах и «воскрешение» из мертвых

Совсем недавно, на рубеже XX и XXI веков, сверхпопулярной была программа Photoshop. Теперь на смену ей пришли нейросети, а именно дипфейки (Deepfake). Эта технология куда опаснее, но также перспективнее прежней возможности грубо вырезать лица людей с фотографий и приклеивать их на другие снимки.

Другая история произошла в 2020 году на выборах в Индии. В Дели лидер одной из оппозиционных партий Маноджа Тивари сделал заявление на хинди и на диалекте хариани. При этом говорить на этом языке он не умел. Пойти на обман Маноджа Тивари решился скорее всего из-за желания завоевать голоса рабочих-мигрантов в Дели. Они как раз говорят на диалекте хариани.

И подобных случаев уже много. В истории с лидером индийской оппозиции интересно то, что он так и не признался в использовании технологии: доказать это довольно сложно, вот и признаваться необязательно.

Еще один пример — фильм «Би-би-си» «Добро пожаловать в Чечню» про активистов, критикующих власть. Создатели картины не стали «замазывать» лица оппозиционеров, а наложили на них дипфейки активистов, живущих в Нью-Йорке.

Можно ли вычислить дипфейки

Сложность в борьбе с нечестным использованием технологии заключается в том, что подделки будут становиться только качественнее.

Дипфейк — это генеративно-состязательная сеть. В ней есть генератор и дискриминатор. Генератор создает подделку, а дискриминатор критикует и указывает на ее недостатки. После этих замечаний генератор снова приступает к работе. В итоге появляется очень точный фейк.

Некоторые страны приняли решение регулировать дипфейки законом.

В 2020 году Калифорнийский и Стэндфордский университеты смогли повысить точность выявления дипфейков до 97%. Ученые исследовали виземы и фонемы.

Виземы — визуальное выражение того, как произносится тот или иной звук. Условно — мы говорим что-то и наш рот как-то движется. Филологи пытаются сравнить виземы в дипфейках и в оригинальных видео. Действительно, виземы в дипфейках выглядят немного иначе. Если обучить алгоритмы на таком поле данных, точность распознавания подделки будет достаточно высокая.

Другой способ вычисления обмана — изучение того, как шумит реальное и поддельное видео. Шум в дипфейках немного другой, и часто это удается услышать.

Другая сторона дипфейков

С помощью генеративных нейронных сетей можно создавать контент, используя минимальное количество данных. С этой точки зрения технология связана совсем не с «пересадкой» лиц для веселья, а с практической целью. Сейчас по одной фотографии и тексту возможно генерировать видео. Текст синтезируется в аудио, по аудио анимируются фотографии — в итоге мы получаем говорящего спикера. С помощью этого комплекса алгоритмов можно очень быстро создавать видеоконтент.

Дипфейки могут «воскрешать» любимых актеров. Например, Филип Сеймур Хоффман и Пол Уокер, умершие во время съемок фильмов с их участием («Голодные игры: Сойка-пересмешница» и «Форсаж 7» соответственно), были воссозданы в цифровом виде. А Кэрри Фишер «воскресили» для съемок в девятом эпизоде «Звездных войн».

Мария Чмир, гендиректор Deepcake.io, утверждает, что скоро появится инструмент, который полностью изменит интерактивность. Сегодня все, что дают зрителям, — это выбрать концовку сериала. В будущем с помощью дипфейков мы сможем оказаться внутри киновселенной вместе со своими друзьями. Будет возможность и менять надоевших актеров. Ведь генеративные нейросети позволяют существенным образом редактировать, видоизменять и трансформировать контент.

Именно поэтому дипфейки — это не только манипуляция и дезинформация. С помощью них можно будет снимать фильмы со спецэффектами, оживлять персонажей и в целом добавить новый опыт потребления контента.